- Erfolgsgeschichten

-

Medien

- Medien

- Softeq-News

- Blog

- Häufig gestellte Fragen

- Entwicklung von IoT-Lösungen

- Digitale Transformation

- Entwicklung von Embedded Lösungen

- Hardwaredesign

- Venture Studio

- Kontakt

- ADAS-Lösung für Elektrofahrzeuge

- Mobile App, Web und Firmware für ein intelligentes Babybett

- PCB-Designverifizierung für ein automobiles Radarsensorsystem

- Gerätemanagement-Suite für smarte Thermostate und Raumluftqualität-Sensoren von Daikin

PoC-Gerät für Weitwinkel-Videoaufnahmen

Zusammenfügen von zwei Kameraaufnahmen in Echtzeit

Der Kunde ist ein Anbieter für Telematiklösungen für Versicherungen. Bei dem Produkt in diesem Projekt handelt es sich um ein Gerät, ähnlich einer Dashcam, das an der Windschutzscheibe eines Fahrzeugs installiert wird.

Case Highlights

- NXP-basierte Lösung

- Videoverarbeitung in Echtzeit mit synchroner Belichtung, Weißabgleichskorrektur, Stitching und Squeezing-Algorithmen

- Abdeckung eines Sichtfelds von 200+ Grad

- Wi-Fi- und LTE-Konnektivität

Projektinformationen

Z&M (Zeit und Materiale)

Agile

Firmware-Entwickler

Hardware Engineer

Problem

Der Kunde beauftragte Softeq mit der Erstellung eines Proof of Concept (PoC) für Echtzeit-Videostitching.

Er wollte eine intelligente Fahrerassistenzlösung erstellen – ein Dashcam-ähnliches Gerät, das an der Windschutzscheibe installiert wird. Die Lösung sollte Unfälle erkennen, den Zustand des Fahrers überprüfen und bei Bedarf Notdienste rufen.

Lösung

Video-Stitching in Echtzeit

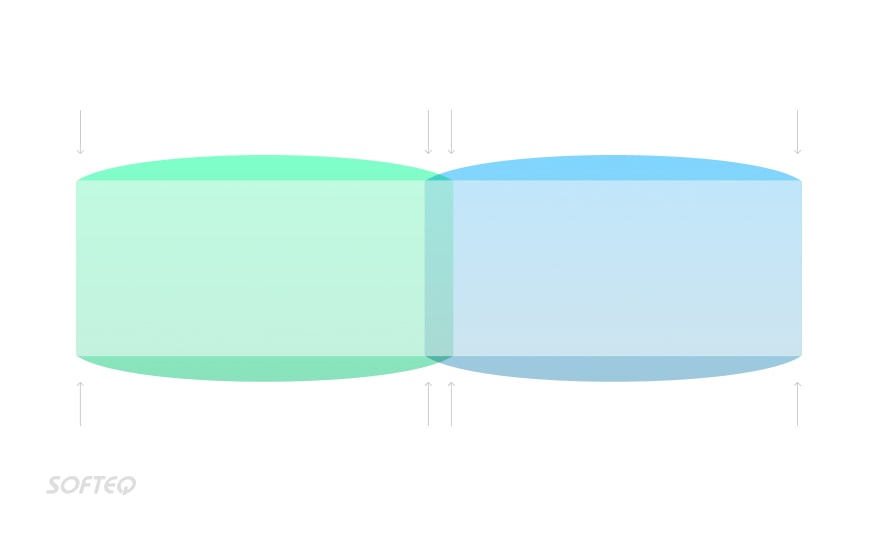

Softeq entwickelte eine PoC-Lösung, die zwei Videosequenzen zu einem Panoramavideo zusammenfügt. Aufgrund der offensichtlichen Unterschiede in der Objektposition, bedingt durch unterschiedliche Kamerawinkel, war das einfache Zusammenfügen der Videos ohne zusätzliche Verarbeitung nicht ausreichend, um ein nahtloses Video zu erstellen. Aus diesem Grund entwickelten wir ein Linux-Board-Support-Paket, das die notwendigen Videokorrekturen in Echtzeit ermöglicht. Die Lösung basiert auf dem NXP-Prozessor und unterstützt Wi-Fi- und LTE-Konnektivität zum Senden von Daten an die AWS-Cloud.

Wie funktioniert diese Lösung?

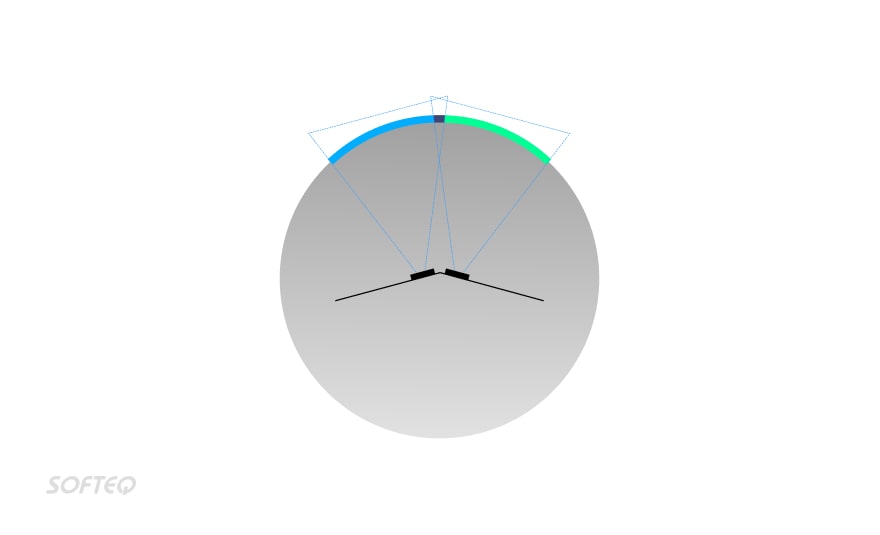

1. Wendet synchrone Belichtungs- und Weißabgleichskorrekturen auf Videomaterial von beiden Kameras an

2. Projiziert die Videos auf eine 3D-Kugel

3. Fügt die Aufnahmen mit einem Algorithmus für glattes Stitching zusammen

4. Überträgt das zusammengefügte Video auf eine zweidimensionale Ebene

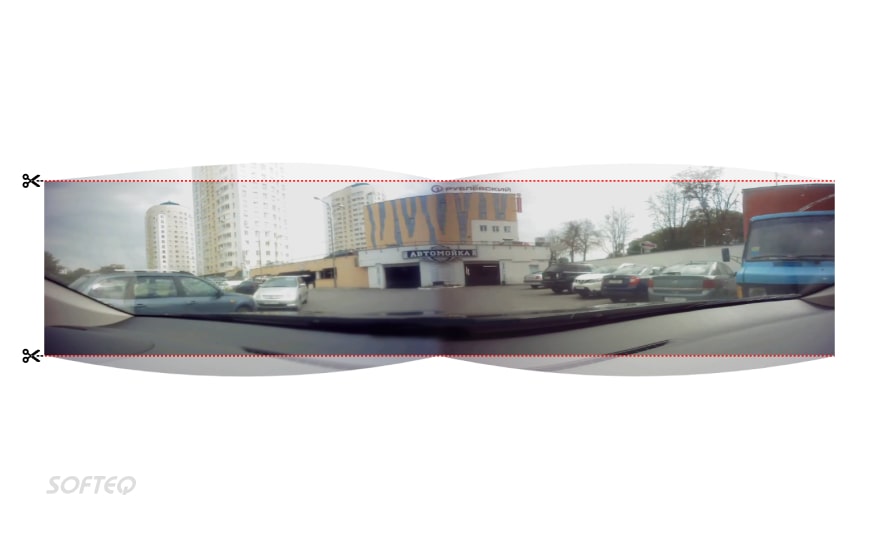

5. Entfernt den Fisheye-Effekt mithilfe der Algorithmen zum Dehnen und Komprimieren

Ähnliches Projekt geplant?

Senden Sie Ihre Anforderungen und erhalten Sie eine profunde Einschätzung Anfrage senden

Ergebnis

Videoaufzeichnung mit großem Aufnahmebereich und Echtzeitverarbeitung

Softeq entwickelte eine PoC-Lösung, die Panoramavideos aus Aufnahmen von zwei Kameras in Echtzeit erstellt. Die Lösung deckt ein Sichtfeld von mehr als 200 Grad ab.

Derzeit arbeiten wir an einer MVP-Version der Fahrerassistenzlösung, die auch Alexa unterstützen wird. Als Nächstes werden wir eine Geofencing-Funktion entwickeln, die den Fahrer benachrichtigt, wenn er in einen unsicheren Bereich einfährt.

Unsere Lösung könnte für weitere Analysen benötigte Daten liefern, falls der Kunde sich für die Entwicklung eines ADAS-Systems entscheidet, das Fahrern hilft, Zusammenstöße im Straßenverkehr zu vermeiden.

Ähnliche Projekte